Tous les pays du G7 ont signé le texte, à l’exception des États-Unis. D’autres sujets du numérique ont été discutés, comme l’intelligence artificielle.

La France est bien décidée à se positionner comme pays leader sur la modération des contenus violents en ligne. Le G7 à Biarritz, qui s’est achevé lundi soir, a permis la publication officielle d’une «charte pour un Internet ouvert, libre et sûr».

Cette dernière a été signée par plusieurs géants du Web, notamment Facebook, Google (propriétaire de YouTube) ou Twitter. Tous les pays du G7 l’ont signé, à l’exception notable des États-Unis.

«Nous voulions consacrer le principe de responsabilité des plateformes pour lutter contre les contenus haineux dans le cadre du G7», explique Cedric O, secrétaire d’Etat au numérique, au Figaro. «La charte consacre quatre grands principes: la liberté d’expression, la protection des victimes, le retrait immédiat des contenus terroristes et la lutte contre les contenus haineux.»

Cédric O

Cédric O est né le 18 décembre 1982, d’une mère française enseignante et d’un père cadre coréen. Il a une soeur prénommée Delphine. Diplômé d’HEC, Cédric O n’est pas un novice dans le monde politique. Il se targue d’une expérience d’une douzaine d’années. D’abord aux côtés de Dominique Strauss-Kahn puis en tant que conseiller du cabinet du ministre de l’Economie, Pierre Moscovici, durant le quinquennat de François Hollande. Par la suite, il prend la place de trésorier lors de la campagne présidentielle d’Emmanuel Macron puis de conseiller auprès de ce dernier et du Premier ministre. En mai 2018, il a organisé le premier sommet Tech for good en réunissant une cinquantaine de personnalités de la Tech à l’Elysée, telles que Mark Zuckerberg ou Satya Nadella. Après un passage dans le privé, dans l’entreprise SAFRAN, Cédric O est revenu dans les coulisses de l’état, et devient un proche collaborateur de Mounir Mahjoubi. Le 31 mars 2019, il est nommé au poste de Secrétaire d’Etat au numérique suite au départ de ce dernier.

Enchevêtrement de projets

Cette charte est l’un des nombreux projets autour de la modération proposé en France et au niveau européen depuis plusieurs mois. La France était déjà à l’origine, aux côtés de la Nouvelle Zélande, de l’appel de Christchurch, où une vingtaine de gouvernements et des géants du Web s’étaient engagés à limiter la propagation des contenus extrémistes en ligne. Parallèlement, la France a adopté, cet été, sa propre loi pour lutter contre la haine en ligne. Elle consacre notamment une obligation pour les grandes plateformes à retirer sous 24 heures les contenus «manifestement haineux». Ce texte est directement inspiré d’une autre loi, adoptée en Allemagne en 2017. Enfin, au niveau européen, un règlement communautaire sur le retrait des contenus terroristes a été adopté en avril. Ce dernier propose une obligation de retrait des contenus terroristes pour les plateformes, cette fois-ci dans un délai d’une heure. Le texte doit encore faire l’objet d’un vote final avec les nouveaux députés européens fraîchement élus.

En coulisses, du côté des entreprises comme de certains experts, cet enchevêtrement de projets nationaux et européens provoque un certain scepticisme. D’autant que les visions défendues ne sont pas forcément les mêmes. Ainsi, aux États-Unis, Donald Trump dénonce davantage la supposée censure menée par les réseaux sociaux contre les personnalités conservatrices, que la lutte contre les contenus terroristes. Surtout quand les attentats en question sont menés au nom d’une idéologie d’extrême droite, comme ce fût le cas lors du massacre de Christchurch. Au G7, les États-Unis ont tout de même accepté de participer aux discussions sur la charte, mais ne l’ont pas signé.

» LIRE AUSSI – L’administration Trump veut encadrer la modération des réseaux sociaux

«C’est une bonne chose qu’il y ait une prise de conscience internationale sur le sujet. Les Américains reconnaissent désormais qu’il y a un problème et que les réseaux sociaux doivent prendre leurs responsabilités», se félicite toute de même Cédric O. «L’objectif final est que ça se traduise au niveau européen.»

D’autres sujets sensibles ont cependant été évacués. Par exemple, la charte ne mentionne aucun délai de temps obligatoire pour modérer les contenus haineux. Le sujet a déjà fait l’objet d’âpres débats lors du vote de la loi française sur le sujet. Seul les contenus terroristes font l’objet d’un engagement de retrait «immédiat».

Un partenariat mondial autour de l’intelligence artificielle

Plus timidement, l’intelligence artificielle s’est aussi fait une place parmi les thèmes des échanges du G7. Après plusieurs mois de négociation, un «Global Partnership for AI» (Partenariat mondial pour l’intelligence artificielle) va être annoncé dans les déclarations finales d’Emmanuel Macron et Donald Trump. «Cette initiative franco-canadienne vise à créer une instance de réflexion mondiale permettant d’éclairer les pays sur l’utilisation de l’intelligence artificielle et éviter ses dérives, explique le Secrétaire d’Etat au numérique Cédric O. C’est la première discussion multipartite, où se rencontreront à la fois les responsables politiques des pays membres de l’OCDE, des chercheurs, des entreprises, pour parler des risques et opportunités de cette technologie, par exemple dans le domaine de la reconnaissance faciale», poursuit-il. Ce thème est particulièrement sensible pour le Président Emmanuel Macron, affirme une source proche du dossier.

Les contours de ce partenariat mondial restent encore relativement flous et s’orientent davantage vers la diplomatie que la régulation. «L’objectif n’est pas d’aboutir à des recommandations règlementaires, mais d’ouvrir pour la première fois une telle discussion à l’international», précise ainsi Cédric O. L’OCDE et la Commission européenne s’étaient en effet déjà emparés du sujet de l’intelligence artificielle en créant des groupes de réflexion et en promulguant des conseils autour de l’éthique en intelligence artificielle.

Le fait d’avoir réussi à convaincre le président Donald Trump de reconnaître le partenariat est perçu comme une victoire arrachée de haute lutte, jusqu’à la dernière minute. «Avant le G7, le soutien des Etats-Unis était loin d’être acquis sur le sujet», confie ainsi Cédric O. Côté calendrier, les détails techniques devraient être finalisés dans les prochains mois.

YouTube, Facebook, Twitter : l’échec de la modération

Publié le 05 juin 2019 – www.lemonde.fr

Analyse. C’est un éternel recommencement : lundi 3 juin, le New York Times publiait une longue enquête montrant que des vidéos familiales d’enfants peu habillés, publiées sur YouTube, ont accumulé des centaines de milliers de vues après avoir été proposées par l’outil de recommandation de la plate-forme à des internautes intéressés par des vidéos d’enfants dénudés. Le problème n’est pas franchement nouveau : il est clairement identifié depuis plus d’un an, et malgré les mesures annoncées en 2018 par YouTube, dont une amélioration des outils de modération et la fermeture des commentaires sous les vidéos de mineurs, il est toujours là.Lire aussi Sur YouTube, les vidéos d’enfants restent le terrain de jeu de pédophiles

Comment les sites d’information modèrent-ils leurs commentaires ?

Publié le 25 août 2015 — Mis à jour le 06 février 2019 – https://larevuedesmedias.ina.fr

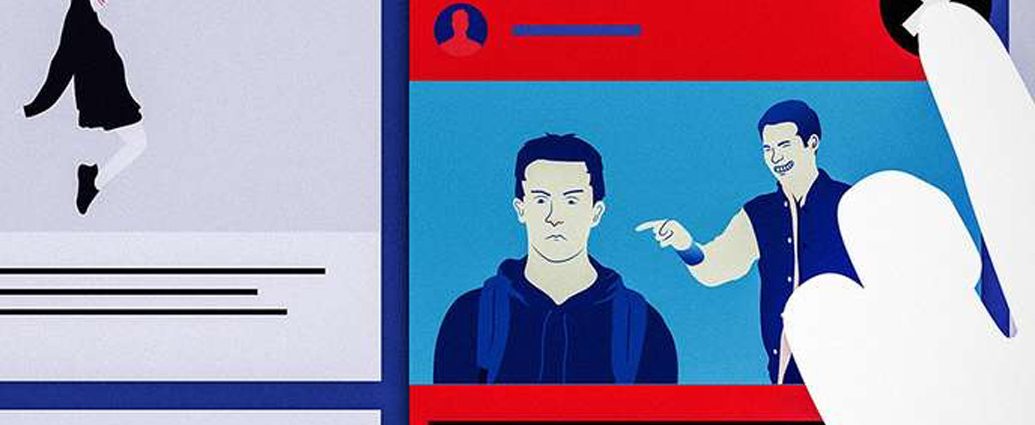

Le 16 juin 2015, la Grande chambre de la Cour européenne des droits de l’homme a créé la polémique. En sanctionnant le site d’information estonien « Delfi » pour ne pas avoir supprimé des commentaires injurieux, la Cour réaffirme et entérine sa position antérieure : les sites web sont chargés de réguler leurs commentaires et d’anticiper les éventuels débordements liés à un article. Pour le moment, cette décision n’a pas été traduite en droit français mais cela pourrait être le cas dans les mois qui viennent. Désormais le « tout interactif » a un prix, celui d’assurer une régulation efficace des contenus publiés par les lecteurs sous peine de dommages-intérêts. Cette régulation a aussi un nom : la modération. Modérer, c’est savoir appréhender l’épineuse question des flux de commentaires. Pour un site d’information, il s’agit de la capacité à réguler les contenus produits par les lecteurs en jonglant entre « liberté d’expression » et contraintes juridiques ou éditoriales. Cette charge est assumée par des modérateurs, c’est-à-dire des individus possédant des « droits » de publication, de suppression, d’édition, sur les commentaires postés par les lecteurs. Face à cet impératif de surveillance et de régulation, les sites de presse ont progressivement intégré la nécessité de modérer avec efficacité les contenus publiés par les lecteurs. Toutefois, cette contrainte peut devenir insoutenable. Certains journaux, comme Popular Science, ont préféré se passer complètement des commentaires. Dans une longue tribune, le magazine estime en effet que ces contenus sont « mauvais pour la science » et qu’il était préférable de ne plus offrir cette possibilité au lecteur, parce que les commentaires, même peu nombreux, sont susceptibles d’altérer la perception d’un article.

Avec l’arrivée du Web participatif émerge une forme d’idéal démocratique : tout lecteur est invité à se joindre au débat. D’abord concentrés sur les forums de discussion, les commentateurs investissent rapidement les sites d’information puis les réseaux sociaux à la fin des années 2000. Les espaces ouverts à la discussion se multiplient rapidement et les flux deviennent, par moment, incontrôlables. Dès lors, gérer et réguler cette masse de nouveaux contenus s’avère de plus en plus difficile, nécessitant des moyens humains et techniques conséquents. En réaction à cette nécessité, les sites d’information se voient alors proposer les services de sociétés spécialisées dans la modération de contenus. Rapidement, l’externalisation de la modération – c’est-à-dire la sous-traitance par des sociétés dédiées à la modération – devient la règle. Quelques pure players, dont Rue89 fait figure de proue, résistent à cette tentation en assurant eux-mêmes la modération.

Modérer a priori ou a posteriori ?

Comprendre la modération revient à appréhender une distinction fondamentale entre les contenus modérés avant publication (« modération a priori ») et les contenus modérés après publication (« modération a posteriori »). Face à l’afflux de commentaires, souvent injurieux, les sites font désormais usage d’une modération a priori dans la plupart des cas. Cette configuration a l’avantage de laisser au modérateur le temps de lire le message avant qu’il soit consulté par le reste des lecteurs. Il ne s’agit pas d’une logique de suppression du message mais bien d’acceptation ou de refus du commentaire. Bien souvent, les sites de presse s’engagent à traiter les commentaires dans les minutes qui suivent la publication par le lecteur afin de garantir une certaine interactivité.C’est donc à partir de cette distinction technique que s’est construite la modération des propos tenus par les lecteurs des sites d’information. C’est aussi à partir de cette distinction que le droit français peut choisir d’engager ou non la responsabilité d’un média. En effet, si les commentaires sont modérés avant publication, le site est considéré comme éditeur des contenus et donc responsable des propos illicites qui y sont publiés. Si tel n’est pas le cas, c’est que le site a adopté une modération a posteriori l’obligeant à mettre en place un système permettant à ses lecteurs de signaler tout commentaire illicite. Le modérateur traitera ensuite les signalements et supprimera les messages litigieux. Ainsi, dans la décision précitée, la Cour européenne des droits de l’homme a probablement souhaité étendre ce régime de responsabilité à l’ensemble du secteur de la presse en ligne, qu’il pratique une modération a priori ou a posteriori.La mise en œuvre de la modération, qu’elle soit a priori ou a posteriori est articulée autour d’un élément central : la charte de modération. Ce texte, toujours accessible publiquement, fait office d’outil de référence en répertoriant un socle de normes que l’on retrouve sur tous les sites d’information. On y trouve diverses interdictions, telles que le fait de tenir des propos pédophiles, incitant à la haine raciale, au négationnisme ou encore appelant au meurtre. La plupart des chartes font explicitement état d’une liste « non-exhaustive » laissant entendre que le cadre juridique régissant ce qui est permis et ce qui ne l’est pas reste encore très flou. Certains journaux, à l’image du Parisien font mention du « droit des personnes » ou encore des « lois et règlements en vigueur » sans préciser de réel fondement légal. Dès lors, il est facile d’observer que les sites de presse ne s’arrêtent pas à ce cadre légal pour y introduire un certain nombre de particularités éditoriales. Certains sites de presse considèrent en effet les commentaires comme de véritables contenus qui méritent d’être valorisés. Dès lors, les exigences ne sont plus uniquement légales mais deviennent qualitatives : argumentation, ponctuation modérée ou encore clarté du propos sont d’usage sous peine de suppression du commentaire. Ces particularités font l’originalité des systèmes de modération dont les exigences sont finalement très différentes d’un site à l’autre, la charte de modération mise à part. Il sera donc difficile d’appréhender toutes ces subtilités au seul regard de la charte de modération. Pour comprendre comment les sites d’information conçoivent la modération, il faut s’intéresser à leur gestion quotidienne des commentaires. Pour ce faire, il faut se rendre là où tout commence : auprès du modérateur lui-même.

Un traitement majoritairement externalisé

Si le commentaire laissé par l’internaute est parfois pourvoyeur d’informations et d’expertise, il est régulièrement injurieux et provocant. De même, le périmètre de modération pour un site de presse en ligne est considérable : forums, sous-forums, articles, réseaux sociaux… Les espaces participatifs ne manquent pas. Il lui revient donc de gérer au quotidien, 24h/24 et 7j/7 une masse considérable de commentaires. L’intensité des flux est telle que la plupart des sites d’information ont décidé de faire appel à des professionnels pour gérer la modération.Parmi eux, la société française Netino modère près de 30 sites de presse pour un chiffre d’affaires s’élevant à près d’un million d’euros. Parmi ses clients on trouve la plupart des médias à forte affluence tels que Le Monde, Le Figaro, Les Échos, La Tribune, Capital, Europe 1, RMC, NRJ, M6 ou encore Canal+. Tous les commentaires publiés sur ces médias ou leurs réseaux sociaux passent entre les mains des équipes de Netino. Selon Jérémie Mani, président de Netino, les modérateurs professionnels utilisent un logiciel développé par l’entreprise elle-même : « Moderatus ». Cette plateforme centralise tous les commentaires en temps réel afin qu’ils soient traités dans les plus brefs délais. L’outil est connecté avec l’ensemble des espaces de dialogue des clients, que ce soit des forums, des blogs, des réseaux sociaux, des commentaires ou des tchats. Dès qu’il y a une opportunité de dialogue, l’outil récupère le message et le donne à modérer. En l’absence d’un tel outil, consulter et actualiser chaque espace participatif pour surveiller ce qui est publié serait impossible. Les modérateurs traitent en effet plusieurs millions de contributions chaque mois, ce qui représente un travail particulièrement laborieux et conditionné par l’existence d’outils tels que Moderatus.Dans un souci d’efficacité, le logiciel classe les messages en trois catégories : « à traiter » (pour les commentaires qui n’ont pas encore été lus par le modérateur), « acceptés » ou « refusés ». Mais la mécanique de l’outil ne s’arrête pas là. Afin de garantir un traitement opérationnel des commentaires, le logiciel utilise un système de priorisation complexe.

Les mots « gay », charia » ou « sioniste » sont souvent inclus dans les commentaires injurieux et seront supprimés en priorité

Pour que les commentaires les plus « sensibles » soient traités en premier, la plateforme va se fonder sur plusieurs critères. Le logiciel va d’abord s’intéresser à la source du commentaire, considérant, par exemple, que les risques liés à un message illicite ne sont pas les mêmes sur un forum que sur Facebook. De plus, l’outil va analyser et conserver automatiquement l’historique de chaque contributeur. Il sera possible pour le modérateur de savoir que « M. X » a posté 23 commentaires, dont 8 ont été supprimés ou encore qu’il aime la page Facebook du Monde mais pas celle du Figaro… Un individu ayant un historique particulièrement fourni verra donc ses commentaires traités en priorité par le modérateur. Ensuite, la plateforme va repérer, via des algorithmes, un certain nombre de mots-clés, à l’intérieur des messages, afin d’identifier le caractère litigieux du commentaire. L’expérience démontre en effet que les mots « gay », charia » ou encore « sioniste » sont souvent inclus dans les commentaires injurieux et seront donc supprimés en priorité. Enfin, pour les réseaux sociaux qui nécessitent une modération a posteriori, le logiciel va analyser la viralité du message. Si un commentaire Facebook enregistre beaucoup de « likes » ou de commentaires, celui-ci aura une visibilité plus importante et sera donc traité en priorité par le modérateur. Cette alchimie complexe va permettre au modérateur de lire les contenus identifiés comme dangereux dans les secondes qui suivent leur publication.

La décision de la suppression du commentaire est prise par un professionnel

L’automatisation apparente de la modération n’est toutefois qu’une illusion. Seule la dynamique de priorisation est gérée par un logiciel. Le reste est bel et bien traité par des humains, ce qui constitue un travail particulièrement laborieux. La plateforme « Moderatus » permet de mettre en évidence un message à risque mais la décision quant à la suppression ou non du commentaire est prise par un professionnel. A ce jour, l’outil n’est pas (encore) capable de repérer le sarcasme ou le cynisme dont savent faire preuve les habituels provocateurs…

Une modération propre à chaque ligne éditoriale

Les 400 modérateurs professionnels qui travaillent chez Netino ne se contentent pas de supprimer les messages litigieux. Parfois, il est nécessaire d’empêcher des commentateurs récidivistes de publier. Il s’agit alors de prendre la décision de bannir le membre des espaces participatifs, de manière temporaire ou définitive. En l’absence de consignes particulières, le modérateur alerte le site de presse pour lui demander l’autorisation d’exclure le membre. Cette exclusion se traduit par l’impossibilité de commenter et peut s’accompagner, pour les journaux payants, d’une rupture d’abonnement. Cette décision est évidemment lourde de conséquences et suppose une forte relation de confiance entre le média et la société de modération.Certains sites d’information font preuve d’une plus grande souplesse. Par exemple, Libération a choisi d’ouvrir ses commentaires aux lecteurs qui sont inscrits sur le siteet pas aux seuls abonnés. Pour le quotidien, l’investissement financier que représente un abonnement n’indique pas que les commentaires publiés seront de meilleure qualité ou qu’ils respecteront davantage la charte de modération… Lorsque Concileo, l’entreprise qui gère les espaces participatifs du site, décide de bannir un commentateur, il suffira à ce dernier de se recréer un compte avec une nouvelle adresse mail pour pouvoir publier à nouveau.

Ce qui est considéré comme agressif sur un site de presse ne le sera pas nécessairement partout

Pour faire face aux différentes sensibilités éditoriales, les sociétés spécialisées dans la modération utilisent des équipes dédiées à chaque site de presse. Ainsi, les modérateurs assimilent à la perfection les subtilités et les exigences de leurs clients. Les modérateurs professionnels ont à leur disposition une charte bien plus développée que le texte accessible publiquement sur le site. Dans ce document, les sites d’information détaillent leurs attentes avec précision en notifiant au modérateur quelle attitude adopter dans différentes situations. Il y a donc une base commune, que l’on retrouve sur tous les sites d’information et une vingtaine d’éléments qui varient d’un site à l’autre. A titre d’exemple, certains journaux sont très attachés au respect des droits d’auteur, à la prohibition du spam ou des messages écrits en majuscules (une façon de « crier » ou d’exprimer son agressivité sur internet). D’autres vont avoir des exigences plus idéologiques, propres à leur ligne éditoriale et auront plus de mal à accepter des commentaires qui iraient à l’encontre des principes fondateurs du journal. Ainsi, ce qui est considéré comme agressif sur un site de presse ne le sera pas nécessairement partout. Pour le modérateur, il devient donc difficile d’interpréter ce qui relève du sarcasme ou de la provocation. On entre ici dans la subjectivité propre à l’exercice de la modération. Le traitement de plusieurs centaines de contenus par jour met la concentration et les nerfs du modérateur à rude épreuve.

Dans le cadre d’une externalisation de la modération, le fait de mutualiser les équipes apparaît donc très difficile. Les exigences propres à chaque site d’information sont telles qu’un modérateur ne peut traiter indifféremment les commentaires de l’Obs et ceux du Figaro. Ainsi, par exemple, les équipes affectées au Monde par la société ne traiteront que les contenus publiés sur les espaces participatifs du journal.

Crédits photo : La Revue des médias. Illustration : Guillaume Long.

L’avènement des modérateurs étrangers

Une telle organisation nécessite de mobiliser un très grand nombre de modérateurs professionnels. La société Netino possède plusieurs centaines de modérateurs répartis entre la France, l’Amérique Latine, le Québec et surtout à Madagascar.

Si les sites d’information externalisent, les sociétés qui s’en chargent procèdent elles aussi à une forme d’externalisation, plus connue sous le nom de « délocalisation »… Jérémie Mani, président de Netino, justifie ce choix par deux arguments. Le premier est économique. Bien que payés au-dessus du salaire minimum, les modérateurs étrangers sont bien moins rémunérés que les modérateurs français. Toutefois, l’intérêt de délocaliser la modération ne s’arrête pas là.

Tout d’abord, modérer s’avère être une activité particulièrement laborieuse et le modérateur étranger va posséder « le recul nécessaire, l’absence de jugement » face une actualité qui, bien souvent, ne le concerne pas. La logique des sociétés de modération est très proche de celle des centres d’appels. Il s’agit de faire travailler à bas coût des gens qui ne voient « aucun inconvénient à effectuer ce travail répétitif ». Toutefois, un modérateur français est remplacé par « 3 ou 4 modérateurs malgaches » précise Jérémie Mani. Il faut donc un certain temps pour former et encadrer ces équipes qui travaillent depuis chez eux ou dans des locaux de 250 m2. Les modérateurs étrangers sont souvent d’anciens journalistes que le secteur de la presse a poussés vers le chômage et qui sont « très fiers » de travailler pour « de grands médias français ».

D’un point de vue qualitatif, les sociétés de modération attachent une grande importance à la formation de ces modérateurs. Les périodes de formation s’enchaînent et le travail des nouveaux recrutés est surveillé de près par des cadres-formateurs. Beaucoup de modérateurs étrangers commencent par modérer « à blanc » (c’est à dire des contenus déjà traités par d’autres professionnels) avant de se lancer définitivement. Rapidement, ils connaissent les sujets d’actualité, s’imprègnent des débats qui animent les lecteurs français et identifient les commentateurs chevronnés. Une fois véritablement intégrés, Jérémie Mani affirme qu’ils travaillent aussi efficacement, « voire plus », que les modérateurs français.

La seule différence entre les salariés français et les salariés étrangers est liée au temps dont dispose chaque modérateur pour traiter les commentaires. Un modérateur malgache aura plus de temps pour comprendre et contextualiser le commentaire avant de prendre sa décision. Enfin, parmi ses clients, la société Netino compte aussi des entreprises publiques telle que France Télévisions. Ces dernières font uniquement appel aux équipes françaises de Netino, soit une cinquantaine de modérateurs dont vingt-cinq en télétravail.

Face aux flux, une tendance au durcissement

Afin de maintenir une gestion efficace des flux de commentaires, sans cesse croissants, la tendance est au durcissement des politiques de modération.Les consignes données aux modérateurs se rapprochent peu à peu d’une forme de « tolérance zéro », dans la continuité de la théorie de la « vitre brisée » développée par James Wilson et Georges Kelling. Si un individu brise la vitre d’une maison et que cette dernière n’est pas immédiatement remplacée, certains pourront en déduire que la maison est abandonnée. En l’absence de condamnation, cet individu sera incité à récidiver. De même, d’autres personnes seront tentées de briser des fenêtres à leur tour.Il en va de même pour la modération. Le caractère public et la grande accessibilité des espaces participatifs poussent les internautes à réagir. Il n’est pas rare que des situations dérapent et que les contenus deviennent rapidement illicites. Les trolls, habituels provocateurs qui investissent en masse les zones de dialogue, sont la cible privilégiée des modérateurs. Face à ces perturbateurs, bien souvent très organisés, la réponse du site de presse doit être immédiate. Cette nécessaire réactivité justifie souvent le choix d’externaliser la modération et d’opter pour des consignes sévères.Aujourd’hui, la qualité du commentaire tient davantage à sa forme et non à la pertinence des arguments développés. Lorsque les sites d’information s’initiaient au web participatif, certaines rédactions prenaient le temps de réécrire intégralement les quelques commentaires postés par les internautes, en y supprimant les fautes d’orthographe et corrigeant certaines expressions. Cette situation est évidemment inimaginable aujourd’hui…

La modération a priori est souvent vécue comme un acte de censure

Externaliser la régulation des commentaires n’est pas un choix facile à assumer pour un site de presse. Cela suppose une parfaite coordination de journal et de ses exigences avec les équipes de modérateurs. Ces exigences sont souvent le fruit d’une conception propre au rédacteur en chef et donc, susceptible d’évoluer régulièrement. Lorsque la modération d’un site de presse connaît des changements, les lecteurs sont avertis. Le changement d’une modération a posteriori vers une modération a priori est souvent vécu comme un acte de censure, défiant la liberté d’expression. La réaction est souvent immédiate. Les « communautés de fait » qui se forment au fil des discussions ne tardent pas à manifester leurs remarques et, le plus souvent, leur mécontentement. En effet, on observe que la modération est le reflet d’une politique éditoriale, de l’idée que se fait un journal des contenus publiés par ses lecteurs. Lorsqu’un site de presse connaît une trop forte affluence, il aura alors tendance à voir les commentaires comme une contrainte nécessaire. C’est là qu’interviennent les sociétés spécialisées dans la gestion et la régulation des espaces participatifs. Cette intervention est d’autant plus essentielle que les réseaux sociaux finissent par avoir vocation à intensifier la réaction des lecteurs.

La modération en interne : un modèle idéal ?

Il est difficile quel est l’apport de la modération des commentaires pour les sites de presse. En adoptant une politique de modération plus sévère, le National Journal a vu son audience augmenter sensiblement. Si l’audience et la crédibilité d’un site de presse peuvent en bénéficier, l’objectif principal consiste surtout à ce que la régulation de contenus publiés par les lecteurs ne coûte pas trop cher. Si les contrats avec les sociétés de modération commencent à 1 000 euros par mois pour des sites de faible affluence, ils peuvent aussi s’étendre jusqu’à plus de 20 000 euros pour les plus gros périmètres de modération. Sur les trois millions d’euros de chiffre d’affaires de Netino en 2014, un million provenait de la modération des sites de presse.Face à cet investissement conséquent, un faible nombre de sites de presse ont fait le choix de modérer eux-mêmes les commentaires. Dans une telle situation, les pure players que sont Mediapart ou Rue89 sollicitent les journalistes pour modérer les commentaires publiés sous leurs articles. Atlantico a décidé quant à lui de confier cette tâche à Marie Slavicek, une journaliste en charge du community management(Social Media Editor). Une logique que cette dernière juge « davantage participative que répressive ». L’idée est d’instaurer un dialogue entre le journaliste et les lecteurs afin d’initier un débat de fond. Techniquement, les journalistes ou Community managers possèdent des droits leur permettant d’éditer ou de supprimer les commentaires. Ils sont donc garants du respect de la charte de modération établie par le site.Toutefois, seuls les lecteurs abonnés ont le privilège de commenter les articles. Les flux sont particulièrement réduits, permettant aux journalistes de se consacrer au fond des débats. Le modérateur – ici journaliste – endosse un nouveau rôle, qui est celui d’animateur. Par conséquent, le contenu publié par le lecteur a une valeur très particulière puisqu’il s’inscrit dans la continuité de l’article. « Internaliser » la modération revient à placer le commentaire au centre de la politique éditoriale du média. En ce sens, nous pouvons évoquer Rue89 qui considère que le commentaire est l’une des « trois voix du site avec celle des journalistes et des blogueurs/experts ».A ce jour, il est difficile de prédire l’avenir des commentaires sur les sites d’information. Les rédactions multiplient les initiatives afin de valoriser ces contenus, à l’image des « Discussions » du Monde, sans véritablement trouver de modèle satisfaisant. La seule certitude est que persiste une forme d’insatisfaction chronique chez les journaux, qui ne savent que faire de ces contenus au fort potentiel. Face à la richesse de certaines publications, tout l’enjeu des années à venir sera donc de mettre en valeur ces nouvelles formes de publications, afin que le « tout répressif » soit remplacé par le « tout participatif ».

AUTRE SUJET, A LIRE :

Voici à quoi ressemblerait une «charte mondiale des droits sur internet» – 6 novembre 2015 – VOIR ARTICLE – Slate.fr

E-administration : Cédric O envisage de « réintroduire de l’humain »

Par Xavier Berne le lundi 26 août 2019 – www.nextinpact.com

Alors que le Défenseur des droits a une nouvelle fois dénoncé les dérives de l’e-administration, Cédric O, le secrétaire d’État au Numérique, vient de déclarer qu’il faudrait « probablement (…) réintroduire de l’humain, à commencer par des numéros de téléphone, par exemple ».

« Simplifier et rendre facilement accessibles les démarches en ligne est l’une de mes priorités » a réagi le secrétaire d’État au Numérique, samedi 24 août, depuis son compte Twitter. Cédric O concède ainsi que le Défenseur des droits, Jacques Toubon, « a raison : depuis plusieurs années, la dématérialisation des procédures administratives s’est trop souvent faite sans partir de l’accessibilité et de l’expérience des usagers, ou à tout le moins de certains d’entre eux ».

La semaine dernière, dans une interview aux Échos, l’ancien ministre de la Justice de Jacques Chirac dénonçait une fois de plus les « carences dans les processus publics de dématérialisation ».

Les problèmes ne sont pas nouveaux. Le Défenseur des droits y avait d’ailleurs consacré un long rapport, en début d’année : défauts de conception, ergonomie « trop souvent négligée », etc. Sans parler des problèmes liés à la capacité de chacun à réaliser des démarches en ligne.

« Nous publierons dans les mois à venir un indicateur de satisfaction pour chaque démarche administrative dématérialisée et présenterons prochainement un plan de marche visant à améliorer drastiquement l’expérience des démarches en ligne, pour TOUS les citoyens », a promis Cédric O.

Un « plan de marche » sur l’UX, des efforts sur les contacts téléphoniques

D’après l’ancien conseiller d’Emmanuel Macron, « l’identité numérique contribuera grandement à faciliter les démarches en ligne dans les années à venir ». Une référence à la carte d’identité numérique, qui pourrait être déployée en France à partir de 2022 selon Nadi Bou Hanna, le directeur interministériel au numérique (voir interview).

« Nous devrons probablement aussi réintroduire de l’humain, à commencer par des numéros de téléphone, par exemple », ajoute enfin Cédric O. Une annonce très prudente, mais qui semble faire encore une fois écho aux tristes constats du Défenseur des droits.

Pour son rapport de janvier, l’autorité indépendante avait en effet conduit une « enquête mystère » auprès des plateformes téléphoniques de plusieurs administrations, afin de « mesurer leur capacité d’accueil, d’écoute et de réponse aux sollicitations des usagers ».

Résultat ? La majorité des appelants était « trop rapidement réorientée vers le site Internet de l’organisme »… Jacques Toubon pointait en outre du doigt les délais d’attente et la surtaxe de certains numéros, à l’origine de nombreux découragements.

Rappelons enfin qu’à compter du 1er janvier 2021, les administrations (CAF, Pôle emploi, etc.) ne pourront plus recourir à des numéros surtaxés.

Comments are closed, but trackbacks and pingbacks are open.